Por William Rocha – Sócio do escritório Terra Rocha Advogados, Diretor de Inclusão Digital e Inovação da OAB-RJ – Colunista convidado.

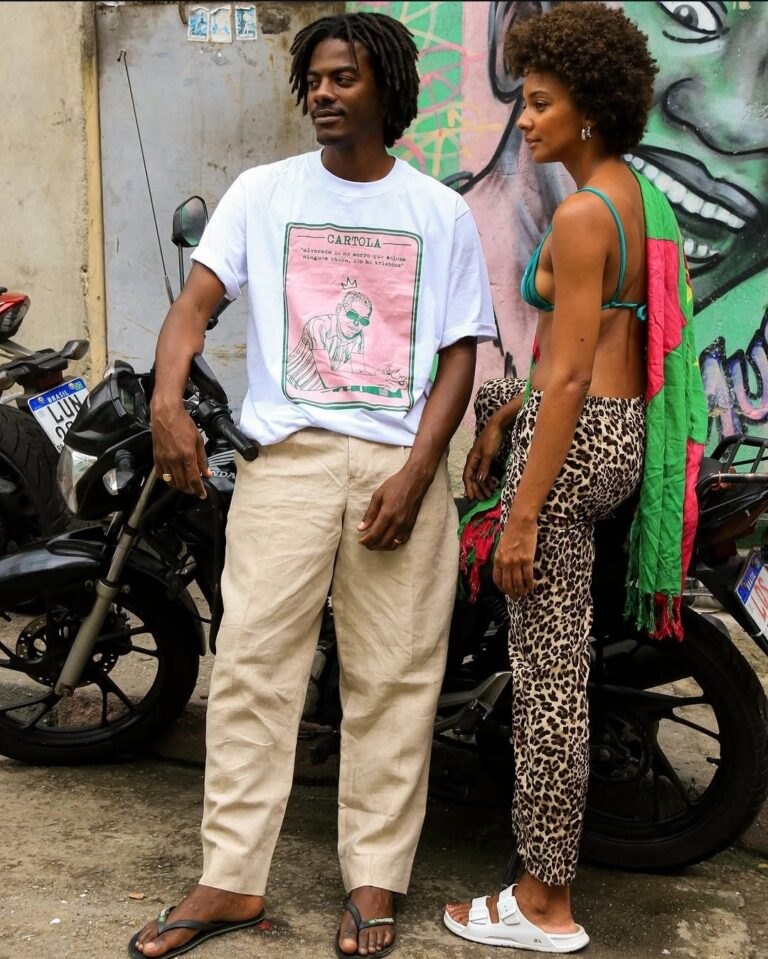

A ascensão da inteligência artificial e dos sistemas automatizados de decisão revela um fenômeno sensível: a chamada eugênia algorítmica.

Trata-se do uso de dados e estatísticas para classificar, priorizar ou excluir indivíduos com base em padrões preditivos. Sob a promessa de eficiência e neutralidade, algoritmos passam a influenciar decisões com impacto direto em direitos, acesso a oportunidades e reconhecimento social.

A lógica parece técnica, mas não é neutra. Sistemas são treinados com bases históricas que refletem desigualdades estruturais. Ao transformar esses dados em critérios decisórios, o algoritmo pode reforçar distorções existentes, convertendo correlações em parâmetros normativos.

O que se apresenta como objetividade estatística pode, na prática, reproduzir exclusões de forma mais sofisticada.

Nesse cenário, ganha relevância o conceito de discriminação algorítmica, caracterizado pela produção de resultados desiguais por sistemas automatizados, muitas vezes sem intenção explícita.

Nesse cenário, ganha relevância o conceito de discriminação algorítmica, caracterizado pela produção de resultados desiguais por sistemas automatizados, muitas vezes sem intenção explícita.

Modelos preditivos, ao operarem com probabilidades, tendem a generalizar comportamentos, deslocando a análise do indivíduo para o grupo ao qual ele é associado. É a lógica da estatística substituindo a singularidade.

A chamada eugenia digital manifesta-se em múltiplos contextos: concessão de crédito, processos seletivos, políticas de segurança pública e tecnologias de reconhecimento facial.

A chamada eugenia digital manifesta-se em múltiplos contextos: concessão de crédito, processos seletivos, políticas de segurança pública e tecnologias de reconhecimento facial.

Em todos esses casos, decisões são tomadas com base em perfis de risco, o que pode levar à exclusão indireta de determinados grupos.

A discriminação, nesse modelo, não é declarada — é inferida. Um dos pontos mais críticos é a chamada autoridade algorítmica. Há uma tendência crescente de atribuir maior confiabilidade a decisões automatizadas, como se fossem intrinsecamente imparciais.

No entanto, algoritmos não eliminam vieses, apenas os reorganizam em linguagem matemática. A opacidade desses sistemas dificulta a identificação de falhas, tornando a discriminação menos visível e mais difícil de contestar.

Por outro lado, não se pode ignorar o potencial positivo das estatísticas. Métricas bem aplicadas podem revelar desigualdades e orientar políticas públicas mais justas. O campo da justiça algorítmica propõe exatamente isso: utilizar dados para corrigir distorções, e não para legitimá-las. Auditorias, critérios de equidade e mecanismos de transparência são instrumentos essenciais nesse processo.

O desafio jurídico é evidente. A regulação precisa ir além da técnica e alcançar a governança dos dados. No Brasil, a LGPD já oferece fundamentos importantes, como os princípios da finalidade, necessidade e não discriminação.

Por outro lado, não se pode ignorar o potencial positivo das estatísticas. Métricas bem aplicadas podem revelar desigualdades e orientar políticas públicas mais justas. O campo da justiça algorítmica propõe exatamente isso: utilizar dados para corrigir distorções, e não para legitimá-las. Auditorias, critérios de equidade e mecanismos de transparência são instrumentos essenciais nesse processo.

O desafio jurídico é evidente. A regulação precisa ir além da técnica e alcançar a governança dos dados. No Brasil, a LGPD já oferece fundamentos importantes, como os princípios da finalidade, necessidade e não discriminação.

Contudo, sua efetividade depende da incorporação desses valores no desenho dos sistemas, e não apenas na sua fiscalização posterior.

A eugênia algorítmica não é um projeto declarado, mas um risco estrutural. Quando estatísticas são utilizadas sem critérios éticos, tornam-se instrumentos de exclusão silenciosa.

A eugênia algorítmica não é um projeto declarado, mas um risco estrutural. Quando estatísticas são utilizadas sem critérios éticos, tornam-se instrumentos de exclusão silenciosa.

Quando bem aplicadas, podem iluminar injustiças e promover inclusão.

O futuro da inteligência artificial, portanto, não será definido apenas pela inovação tecnológica, mas pela capacidade de transformar dados em justiça.